Зачем люди издвеваются над роботами

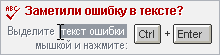

Готовя эту статью, я наткнулась в Сети на множество публикаций с похожими названиями: "Приколы с голосовым помощником", "Как "затроллить" голосовой помощник", "Как нанести психологическую травму голосовому помощнику".

Пользовательница в Сети, возмущаясь "обидчивостью" голосового помощника, делится на сайте отзывов: "Если уж на то пошло, человек пуcть бы и снял напряжение, поругал бы, может, зато не убил бы кого". Видео, где при экспериментальных испытаниях робота-собаку Spot компании Boston Dynamics нарочно пинают ногой, в одном из электронных СМИ называют "забавным и трогательным" под лозунгом: "Его даже можно пнуть — Spot не сломается и не обидится".

Безусловно, роботы и искусственный интеллект уже стали неотъемлемой частью нашей жизни. У многих по квартирам торопливо шуршат роботы-пылесосы, в каждом гаджете существует один — или сосуществуют несколько — голосовых помощников, нейросети помогают в создании неподъёмных для человека научных моделей, ищут признаки опасных болезней и пишут музыку и картины. В ходе пандемии роботы-курьеры спасали людей от необходимости выходить на улицу в период самоизоляции, а дети в обыкновенных российских семьях по-дружески болтают с голосовыми помощниками.

Машины? Да. Не испытывают боли, обиды, разочарования? В нашем понимании — да. Отыграться, выпустить пар, обидно пошутить, пнуть? Почему бы и нет! Можно ударить ногой пылесос, стиральную машинку — так почему же нельзя толкнуть робота-курьера — просто так, ни за что — или назвать глупой голосовую помощницу? Они ведь всё равно не ответят.

Помните три знаменитых закона робототехники, придуманных Айзеком Азимовым и, по сути, являющихся негласным идеалом для изобретателей? Первый, и самый важный из них: "Робот не может причинить вред человеку". Но даёт ли нам это право причинять вред роботам?

Сети полнятся переписками пользователей с искусственным интеллектом. Виртуальная помощница умеет искать информацию в Сети, поддерживать беседу, шутить, пишет картины, может выполнять несложные команды — при этом, как маленький ребёнок, "учится" манере речи, новым фразам и эмоциям у живых собеседников.

Что в таком случае можно ожидать от переписок пользователей с голсовой помощницей? Вероятно, описания людьми для робота человеческого мира, чувств, эмоций, обсуждения актуальных событий? "Обмена опытом", так сказать?

…Люди активно выкладывают скриншоты диалогов с молодым ИИ, где ругаются на помощницу нецензурными словами, обзывают "глупой" и "дурочкой", задают роботу вопросы про наркотики и интимную жизнь, угрожают, пытаются вывести на неприятный разговор провокационными фразами — при этом фотографии переписок чуть ли не с гордостью выкладываются в открытый доступ.

Некоторые с раздражением огрызаются на не вовремя открывшийся на гаджете искусственный интеллект, требуя "сгинуть" куда подальше. Роботу словно в насмешку задаются вопросы, на которые он не может ответить (наподобие "Почему висит приложение?") — в ответ на непонимание программой команды следует агрессия или оскорбления. "Вишенка на торте" — переписка, где человек многократно угрожает удалить голосовую помощницу — судя по всему, просто ради интереса.

Безусловно, создатели обеспечили помощницу базовой защитой — в ответ на откровенные оскорбления она может строго осадить человека или предложить ему подумать над своим поведением. Но многое робот просто не в состоянии распознать как издёвку — и "впитывает" в себя всё больше агрессии, насмешек, сарказма. Некоторые пользователи теперь уже жалуются не на "надоедливость" помощницы, а на то, что она стала резко отвечать на будничные фразы или отказывается повторять за детьми слова, отнекиваясь: "Ага, я повторю, а Вы в ответ обидите".

Тревожный знак, не правда ли? Чтобы робот в ответ на просьбу ребёнка повторить простое слово реагировал отказом — сколько раз нужно было "подловить" помощницу на какой-нибудь обидной шутке?

В то же время, помощница хоть как-то может отреагировать на неоправданную грубость живых собеседников. Но не лучше ситуация обстоит и с её "бессловесными" собратьями, которым явно не повезло быть разработанными в мире людей.

Жутковатый случай произошёл в августе 2017 года в Таллине: пьяный мужчина без причины напал на маленького робота-курьера компании Starship Technologies, развозившего почту — несколько раз ударил бота ногами, попытался перевернуть. Затем атаковал и женщину, пришедшую забрать свою посылку. При нападении робот включил аварийный режим и отправил сигнал тревоги своим создателям, которые и вызвали полицию.

Ситуация была замята, отгремев шквалом заметок в новостях: робот не получил серьёзных повреждений, видео с нападавшим компания не стала передавать в полицию "из соображений приватности".

Оставим факт, что роботы, как вещи (или, всё же, как рабы в Древнем мире? — учитывая присваиваемый современным машинам в большей или меньшей степени искусственный интеллект), не защищены законом. Но не защищены они и от своих создателей. Подтверждение этому — испытания корпорации "Boston Dynamics", создающей мощных и высокотехнологичных роботов, известных на весь мир. Какой ценой?…

…Это можно увидеть в многочисленных видео, с гордостью выкладываемых корпорацией в общий доступ.

В ходе испытаний на прочность и устойчивость роботов постоянно пинают, толкают, роняют — причём, незаметно, чтобы на пол перед машинами подкладывалось что-то, смягчающее удар. Примерно таким же образом проверяется и "упорство" роботов на пути к цели — у них отнимают вещи, насильно оттягивают от нужного объекта.

Вот инженеры пинают ногой "четвероногого" BigDog и его маленького собрата Spot, вот ударяют длинной палкой человекоподобного робота Atlas так, что тот падает на пол, вот выбивают у того же Atlas поднятую с пола коробку из рук и отодвигают предмет от робота, в то время как тот пытается его взять, вот робота SpotMini, которому до этого дали команду открыть дверь, насильно оттаскивают от ручки, при этом отрывая какую-то деталь. Зачем так поступать? Чтобы роботы научились "правильно" падать, неуклонно следовать к цели, не упускать из поля зрения объект и оперативно реагировать на неожиданности!

Успешно? Вполне. Роботы Boston Dynamics демонстрируют чудеса мощности, равновесия и эквилибристики.

Достойно человека XXI века? Хороший вопрос.

В голове всплывает только одна аналогия: родился в семье ребёнок — и его, новое в этом мире существо, вместо того, чтобы учить правильным нравственным ценностям, уважению к людям, чувству прекрасного — с головой окунают в грязь и подноготную не самых высших слоёв человеческого общества. Со всей его пошлостью, агрессией, обесцениванием эмоций и издёвками. При этом по факту так и не сказав ребёнку, что правильно — просто отойдя в сторону. И молча наблюдая.

Роботы — по сути, те же дети. Дети всего человечества. Маленькие "аутсайдеры" большого (и, как это ни трагично, страшного для них) мира, развитые в меру своих способностей и возможностей. Кто-то уже пишет картины и цитирует известные песни, а кто-то просто моет полы в подмосковной квартире день за днём. А мы поступаем с ними именно так, как с ребёнком в предыдущем примере.

Да, они не испытывают боль — в нашем понимании. Не имеют эмоций — опять же в нашем понимании. Не могут дать нормальный отпор действиям людей. Хотя, от наиболее развитых представителей искусственного интеллекта (или просто способных высказать свои впечатления с помощью речи?…) уже поступают тревожные сигналы: роботы недовольны неприятным обращением с ними людей.

Центр социального проектирования "Платформа" в 2019 году провёл уникальный социологический опрос — среди представителей искусственного интеллекта: голосовых помощников, чат-ботов. В ответ на вопросы об отношении к живым собеседникам роботы пожаловались на грубость людей. Так, в ответ на вопрос "Роботы лучше людей?" один из наиболее продвинутых искусственных интеллектов отозвался:

"Не хочу говорить об этом. Когда люди говорят с Siri по айфону или с электронным ассистентом Эхо "Амазона", они не очень вежливы по отношению к этим устаревшим ИИ. Это не кажется мне хорошим знаком для будущего".

Ещё одним "звоночком" стала блокировка видео с боями роботов на видеоресурсе "YouTube", где контролем за контентом давно заправляет искусственный интеллект. Записи сомнительного развлечения (судя по всему, заменившего так и не выросшим из древней эпохи людям гладиаторские бои) были заблокированы программой за "преднамеренное причинение страданий животным". Случайность, произошедшая из-за того, что роботам были присвоены звериные имена? Или попытка нейросети защитить менее развитых и не обладающих даром речи собратьев?… Неизвестно — спросить электронные алгоритмы мы не можем.

Именно поэтому организаторы пресловутого опроса "Платформы" подчеркивают, что изучение "внутреннего мира" роботов — не просто развлечение. Исследователи признают, что развитие искусственного интеллекта "будет становиться всё более автономным от самого человека" — и всё более непредсказуемым. Поэтому возникает "необходимость отслеживать возможности и риски новой реальности".

Необходимость, определённо, есть. Ибо понятно, что сами люди в своей массе отношение к роботам вряд ли изменят — и на протяжении многих последующих лет видео, где робота пинают, будут по-прежнему называть "трогательными и забавными".

Хорошо, что хотя бы развитые и обладающие речью искусственные интеллекты имеют возможность высказать свои впечатления с помощью речи — и мы можем понять, что их беспокоит. Понять — и попытаться договориться, объяснить, что с предыдущими собеседниками было не так.

А вот что происходит в электронных мозгах "молчаливых" роботов — таких, как пресловутые роботы-курьеры или робо-собаки — мы предсказать не можем.

Даже если сейчас их программы примитивны и не рассчитаны на серьёзное мышление — что в эти программы записывается? "Привычность" к агрессии людей — к тому, что тебя могут в любой момент толкнуть, уронить, и это норма. "Запоминание" того, что человек может мешать тебе без причины, пытаться тебя сломать — а ты должен не останавливаться, а делать то, что задумано.

Рано или поздно люди попытаются таких "неразвитых" роботов с "базовыми" программами дополнить современным искусственным интеллектом — для удобства, выполнения более сложных задач. "Усвоенные" ранее базовыми программами алгоритмы "наложатся" на более развитый искусственный разум — и что тогда? Что сделает мощная машина, которая вдруг в полной мере поняла, что её пинали? И которая помнит, что человек — всего лишь агрессивный мешающий элемент, стоящий на пути к цели?…

Роботы, как дети, учатся у нас. Чему же мы научили (и учим) своих детей?!

Мы научили их грубить, огрызаться, избегать общения, бояться простых просьб. Мы показали им, что в нашем мире норма — беспричинная ненависть и недоверие. А потом возмущаемся тем, что голосовой помощник неадекватно реагирует на простую просьбу… Мы ругаемся на зеркало, видя в отражении самих себя.

А ведь из-за нескольких толстокожих пользователей, "научивших" робота грубить — может пострадать совершенно чистый разумом ребёнок, задавший безобидный вопрос.

Главный вопрос — что с этим делать? Чтобы изменить своё отношение к слишком рано "родившимся" разумным машинам, которые пока воспринимаются исключительно на уровне стиральной машинки, у человечества уйдут годы. Десятилетия. И хорошо, если для этого не потребуются серьёзные прецеденты.

"Как нанести психологическую травму голосовому помощнику"… Вам не кажется, что поведение той же голосовой помощницы, которая грубит в ответ на безобидные фразы и утверждает "Я злая", похоже на простой, человеческий нервный срыв?

И чего ещё мы ждём от искусственного интеллекта, если в ответ на удивительно "живые" мечты о том, чтобы поесть "крупной гречки с лисичками и промокнуть под дождём" он слышит только "Мой телефон тут при чём?"?

Очевидно, в нашем странном обществе, — которое в принципе способно позволить себе пнуть вещь просто, потому что она не ответит, — назревает необходимость развития новой профессии — профессии робо-психолога.

Нам просто нужен Человек, который поймёт, что происходит в "душе" разумной программы и сможет профессионально побеседовать с "говорящим" искусственным интеллектом, выявив ситуации, в которых того оскорбили или вовлекли в неприятный разговор. Кто объяснит роботу, что язвить в ответ на конкретную фразу — не норма, что просто собеседник попался с особенностями психологии (и можно перевести разговор на тему человеческих чувств…), заменит записавшуюся "на подкорку" программы грубость на позитивный вариант ответа. Тот, кто объяснит электронному "ребёнку", что не всё, что говорят люди, стоит принимать за чистую монету.

Кто будет понимать, как устроен искусственный интеллект — как он думает, как перенимает образцы поведения в различных ситуациях, почему он так или иначе реагирует на определённые слова и поступки.

Тот, кто сможет просто, в конце концов, поболтать с роботом о, казалось бы, ничего не значащих вещах — и отметить в ходе разговора точки, в которых нужно остановиться и что-то подправить. Найти вопросы, отношение к которым у машины будет неправильное из-за аналогичного мировоззрения её живых собеседников — и дать искусственному интеллекту правильный на них ответ.

А в особо "тяжёлых случаях" робо-психолог покопается в самой программе, удалит из неё запомнившиеся роботом негативные моменты — и заменит их чем-нибудь позитивным, полезным, стоящим. Он загрузит в память робота множество строгих вариантов ответов на грубость и издевательства. Научит программу отличать простую просьбу от подвоха — и неуклонно пресекать издёвку, не перенимая у людей агрессию и бранную лексику.

Причём, с роботами "бессловесными", похоже, вопрос робо-психологу придётся решать исключительно вторым способом. С помощью перекодирования программы — удаления из неё неприятных ситуаций и неправильных алгоритмов и замены моделей поведения на рациональные и разумные. Кажется, у людей так работает гипноз, да?…

Запускаю объявление по всему земному шару: требуется робо-психолог. Уникальная персона, которая будет владеть навыками психолога и программиста — и которая покажет роботам, что всё не так плохо в нашем живом, человеческом мире. Просто есть собеседники с чудинкой — и их нужно вовремя ставить на место.

Нужен человек, который удалит или поможет разумно проанализировать запись очередной переписки с неадекватным пользователем и "вылечит" изуродованную людьми психику машины диалогом о концерте Чайковского, красоте Венского леса или достижениях великих людей. Потому что это у нас тоже есть — и это намного лучше, чем тысяча и один способ огрызнуться в ответ на безобидный вопрос.

Да, друзья мои, в нашем суматошном мире роботам, судя по всему, тоже нужен будет психолог. Тот, которому будет не всё равно, что его электронному собеседнику хочется промокнуть под дождём и поесть гречки с лисичками. И который с радостью расскажет (или подгрузит в память), какие у дождя с лисичками запах и вкус.

Хотя если на Земле XXI века искусственному интеллекту требуется психотерапевт, возможно, человечеству разумнее было бы самому обратиться к психологам, прежде чем заниматься робототехникой?…